上一篇文章介绍了高可用 LLM 网关 Bifrost 的安装与基本使用,还未部署的朋友可参考《从零搭建高可用 LLM 网关:Bifrost 部署与上手指南》。若要构建稳定可靠的 LLM 网关,Bifrost 的路由规则至关重要。借助其强大且灵活的配置,您可以轻松实现模型的负载均衡与故障转移。

Bifrost路由规则

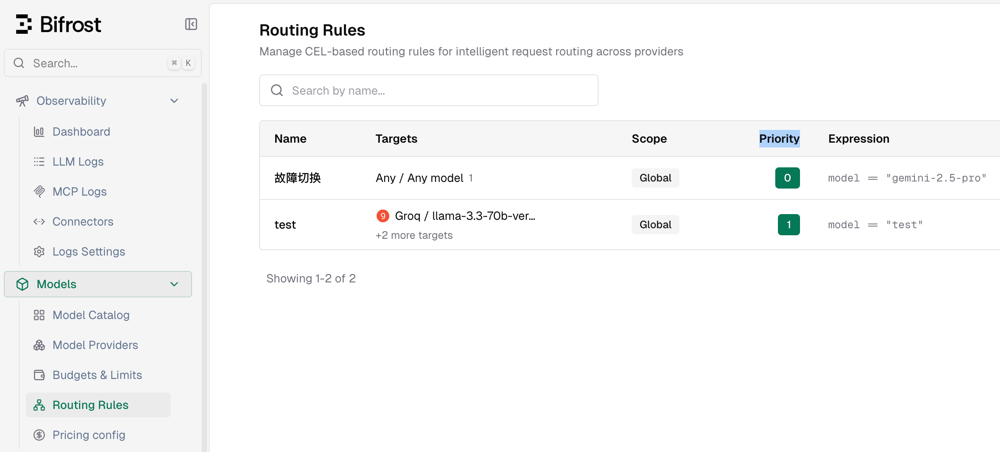

在控制台【Models - Routing Rules】可以添加和管理当前路由规则,如下图。

备注:其中Priority数值越低,优先级越高,

0代表最高优先级。

Bifrost负载均衡

接下来,xiaoz将演示如何在 Bifrost 中配置负载均衡路由规则,实现通过单一入口自动轮询后端多个大模型。

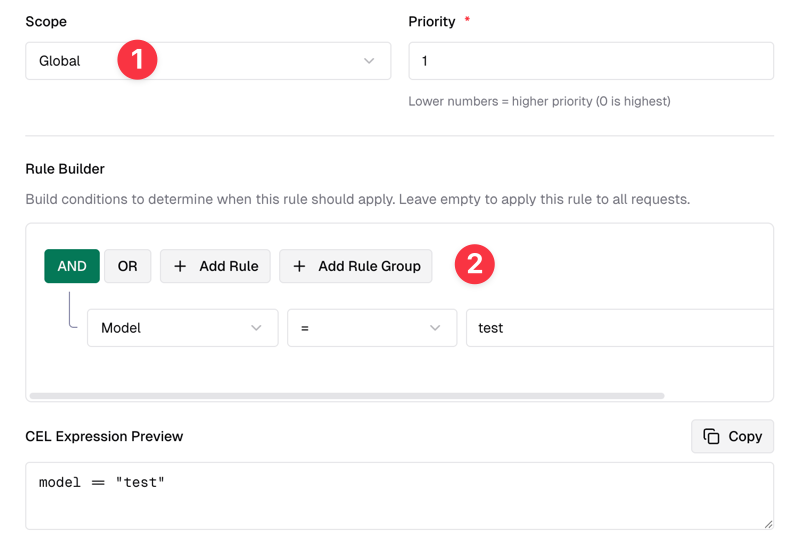

新建一个路由规则:

- Scope选择Global,表示全局生效。

- 在Rule Builder中,选择AND Model="test",这个规则的意思是,新建了一个虚拟模型为

test

如下图所示:

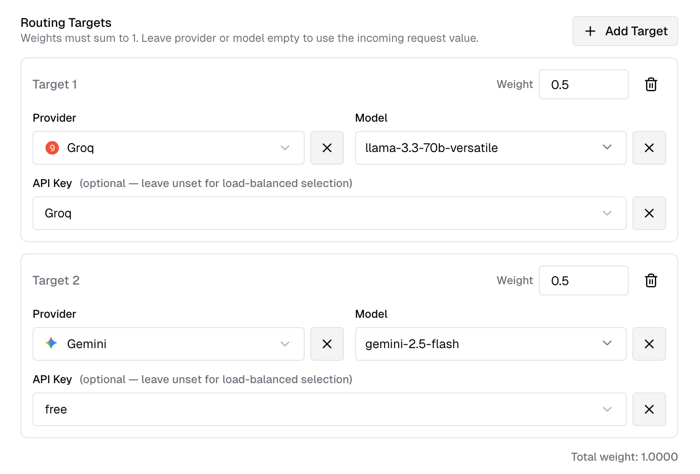

在Routing Targets中,可以选择后端大模型,比如这里xiaoz选择了Groq的llama和Gemini的2.5-flash模型,权重设置的都是0.5,表示每个模型有50%的概率被匹配。

注意:模型可以选择多个,但是权重加起来数值必须

=1

添加完毕后可以使用下面的curl命令进行测试(模型ID使用的刚刚创建的虚拟模型test):

curl -X POST http://IP:8080/v1/chat/completions \

-H "Content-Type: application/json" \

--header 'Authorization: Bearer Virtual Keys' \

-d '{

"model": "test",

"messages": [

{"role": "user", "content": "你使用的什么模型?"}

]

}'多次调用如果AI一会儿回答他是llama一会儿回答他是Gemini,说明负载成功。

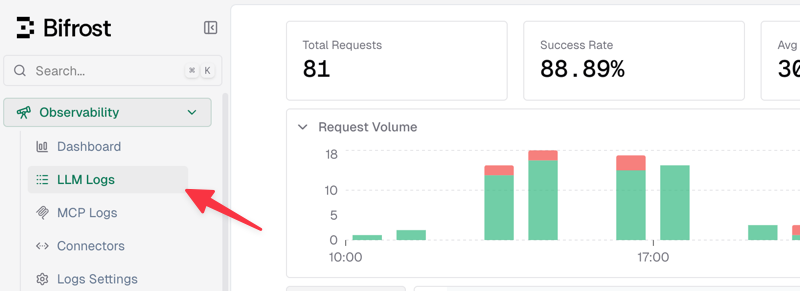

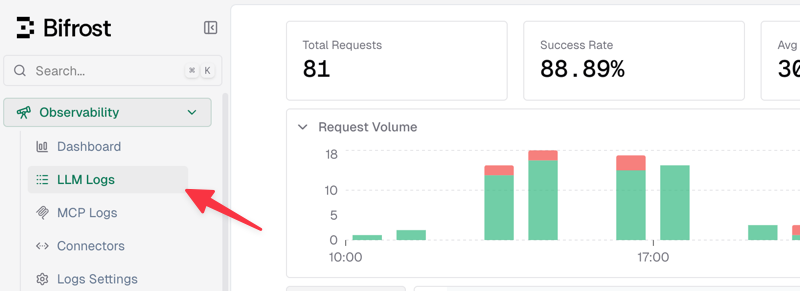

当然,更简单直观的做法是通过控制台【Observability - LLM Logs】直接查看日志来判断,如下图所示区域。

Bifrost故障转移

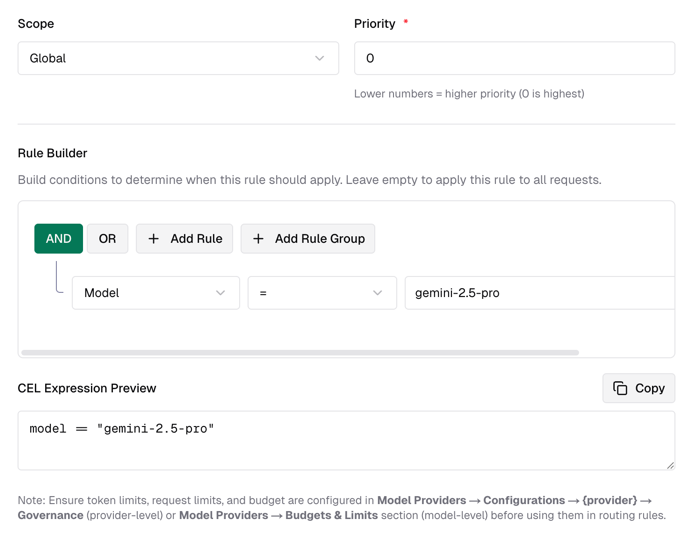

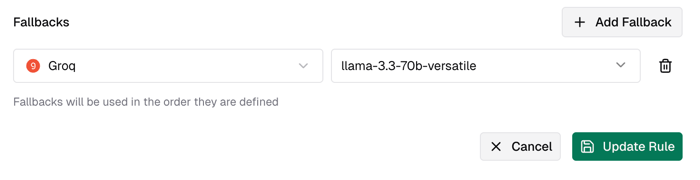

继续新建一个路由规则:

- Scope选择Global,表示全局生效。

- 在Rule Builder中,选择AND Model="gemini-2.5-pro",这个规则的意思是,当模型完全匹配为

gemini-2.5-pro时触发。

如下图所示:

继续设置Fallbacks,选择一个回退模型,这里xiaoz选择的是Groq的llama模型。

这样一个简单的故障转移规则就设置好了,当我们调用gemini-2.5-pro模型时如果出现故障,会自动切换到llama,可以通过控制台【Observability - LLM Logs】直接查看日志来判断。

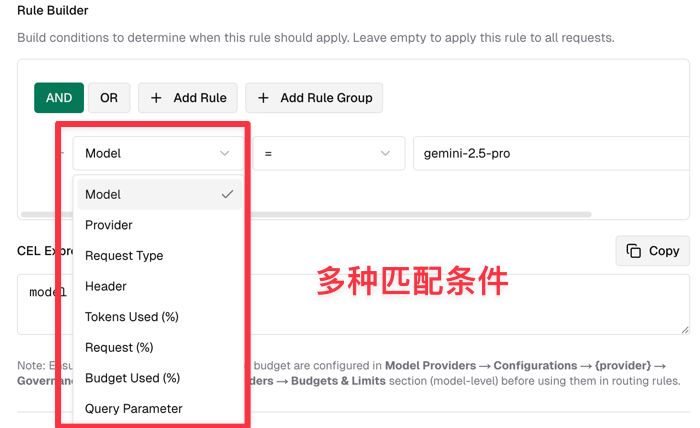

其它

一般建议结合负载均衡和故障转移规则一起使用,从而实现高并发和高可用。另外Bifrost的路由规则还远不止如此,还可以根据请求量、Tokens使用量、请求参数等各种不同条件进行匹配,大家可以根据自身业务情况进一步研究。

结语

到这里,Bifrost 的核心路由玩法就介绍完了。通过简单的配置,你就能让大模型服务具备“负载均衡”和“故障自动转移”的能力,既分摊了压力,又避免了单点故障。当然,Bifrost 还能根据 Token 用量、请求参数等做更精细的控制,大家不妨结合自己的业务场景多尝试,搭建出真正高可用的 LLM 网关。

更多使用说明可访问Bifrost官网:https://www.getmaxim.ai/bifrost